编者按

近年来,网络谣言逐渐出现一些新动向,其中比较典型的便是利用AI工具造谣。随着人工智能技术快速发展,AI谣言呈现数量增多、涉及领域广泛、传播渠道集中、与社会热点话题紧密关联等特征,给政法机关社会治理工作带来较大挑战。今年1月份后,公安部网安局、互联网联合辟谣平台以及各地警方持续通报对多起涉AI谣言的处置情况,引发舆论持续热议。法治网舆情中心从2025年1月以来的涉AI谣言事件中挑出10起热度较高、较具代表性的事件,分析当前AI网络谣言的舆情特征,研判其背后的舆情风险并提出应对建议,供政法机关参考。

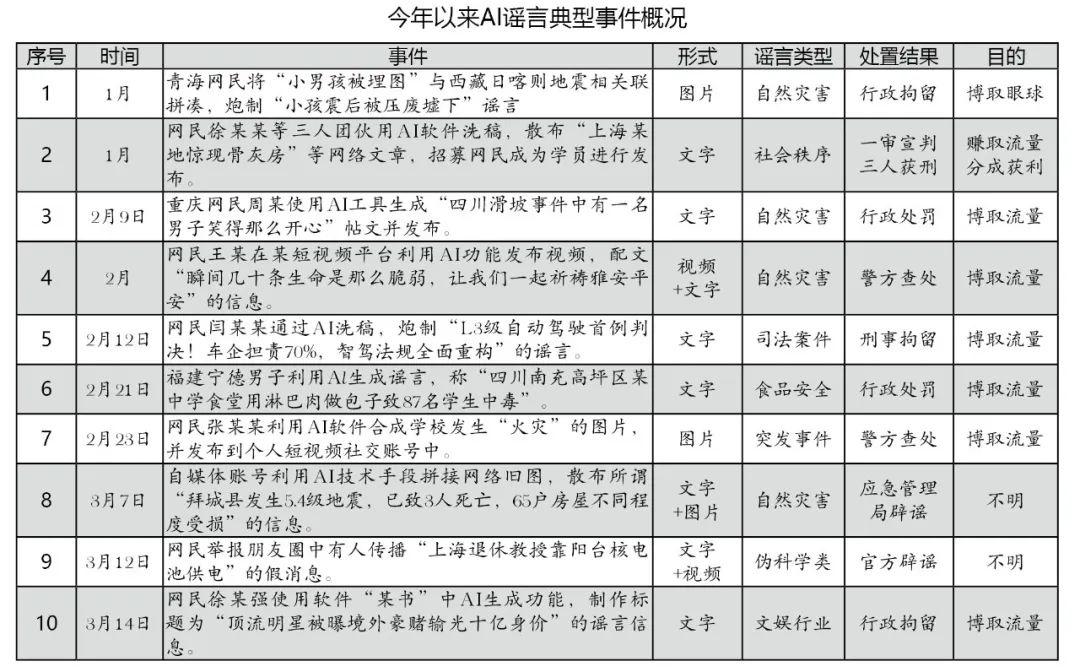

舆情事件

10起典型案例中,有4起AI谣言与自然灾害相关,包括地震、山体滑坡等;2起谣言涉及食品安全和突发事件,分别为“四川某中学食堂用淋巴肉做包子致87名学生中毒”和“某地学校发生火灾”;还有4起谣言分别涉及伪科学、文娱行业、社会秩序和司法案件四个方面。AI谣言表现形式较多,大多通过微博、微信、短视频等社交媒体渠道扩散,并以文字、图片、视频形式单一或“搭配”传播,比如“西藏定日县地震一小孩被压废墟”谣言形式为图片,“上海退休教授靠阳台核电池供电”谣言则是以“文字+视频”的形式传播。造谣动机方面,有8起事件明确提到造谣者是为了蹭热点、赚取流量收益,可见流量经济仍然是AI谣言存在的底层逻辑。10起事件中,有2起事件被官方辟谣,但没有其他情况通报,其余8起均有明确处理结果。处置结果方面,10起事件中有5起事件的造谣者被公安机关给予行政处罚或行政拘留,有2起事件进入到司法流程,网民闫某某因刻意炒作“国内首例智能驾驶致死案”,被属地警方刑事拘留;网民徐某某等3人散布“上海某地惊现骨灰房”等谣言,获利数额较大,被上海当地法院以非法经营罪判处有期徒刑一年十个月不等。

舆情特征

1. 形式多样、细节逼真增强内容迷惑性

相较于人工炮制的谣言,AI谣言在内容上有着更强的迷惑性,主要体现在两个方面。一是传播形式多样。当前的AI谣言已经不止于生成文字、图片、视频等单一形式内容,而是可以实现“文字+图片”“文字+视频”等多种形式的叠加,而不同传播形式之间相互补充和印证,让“有图有真相”“有视频有真相”的欺骗性进一步加深,如四川一男子利用AI制作短视频并配文,称“瞬间几十条生命是那么脆弱,让我们一起祈祷雅安平安”,逼真影像产生强烈冲击效果。二是细节呈现真实。AI生成的内容往往配图、数据齐全。为增加真实性,很多谣言将某个真实细节、某个真实的音视频片段进行嫁接、伪造、混剪,谣言内容真假交织,图文并茂、细节充分,被网民吐槽为“一本正经胡说八道”。比如“首例智能驾驶致死案宣判”这则谣言,从事故认定到诉讼细节再到法院判决结果,整篇文章在逻辑上和专业性上都难以察觉出漏洞,不少媒体都对该“案件”进行了报道。

2. AI技术助长谣言批量化生产、破坏力升级

从上述案例可以看到,AI技术的不断成熟令造谣变得十分容易。造谣者只要提供素材和简单描述,AI技术就能实现“文生图”或“图配文”,前者只需提供文字,就能自动生成相对应的图片,后者则会根据图片内容,自动匹配相应的文字。看似复杂的操作,在AI工具强大的功能下,使用者仅用几句简单直白的指令就可以完成。这种操作方式大大降低了谣言生产的技术门槛,提升了谣言编造效率,帮助造谣者在很短的时间内批量生产出欺骗性很强的内容。如网民徐某某等三人为了博眼球,以获取流量和点击量变现,利用某AI软件将已有文章洗稿后变成伪原创,行为人还通过AI设置“爆款标题”“重复率不得高于25%”等指令逃避平台监管,批量生成近10万条假消息。可见,利用AI技术,谣言制造者可以批量生成大量的虚假新闻内容,并通过自动化工具发布到多个网络平台,以极强的伪装性干扰公众的认知判断,形成较大破坏力。

3. 充当谣言传播“帮凶”助推虚假消息扩散

AI不仅可能成为谣言的始作俑者,还可能充当谣言传播的“帮凶”,成为放大错误和虚假信息的重要一环。具体来看,数据质量对AI内容至关重要,互联网上良莠不齐的信息源在某种程度上加剧了AI内容生成的错误率,自媒体为商业利益制造的虚假信息、历史记录的多版本等,都成为AI模型的“事实陷阱”,形成“垃圾进-垃圾出”的恶性循环。例如,近期成都官方辟谣了“成都艾滋病17万人”的虚假信息,随后就有网民向DeepSeek询问四川艾滋病感染人数,AI给出的答案仍然是“新增17.47万例”。此外,还有一些网民利用AI技术对谣言进行“二创”,如谣言“上海退休教授在阳台搞核发电”在传播过程中,有网民依据文字制作了类似“真人出镜”效果的AI短视频,一本正经地介绍“阳台核发电原理分析”,用言之凿凿的伪科普谣言“取信于民”,产生更大范围的舆论误解。

舆情风险

1. 信息垃圾泛滥,溯源难度大

随着AI生成、伪造或篡改文本、图片、音频和视频的现象趋于普遍,大量粗制滥造、真假难辨的“信息垃圾”充斥舆论场。这些垃圾信息数量庞大,识别筛选难度较高,传播路径复杂,内容碎片化难以溯源。如“上海退休教授靠阳台核电池供电”的谣言主要表现为两个版本,一个是在朋友圈等圈群中传播的文字版,一个是短视频版,但文字版本标明“讨论内容来自短视频”,短视频的内容又称“引用了文字版本内容”,再加上AI技术具有匿名性和隐蔽性,使得谣言鉴定追踪的难度增大。同时,由于AI背靠庞大数据库,对于各类领域的谣言都可以“信手拈来”,这就为造谣者提供极大便利,他们可以借助AI轻松突破知识壁垒,为达到某种目的针对目标人群输出特定观点或情感化内容,致使谣言呈现一定的针对性和私密性,在扰乱公众视听的同时难以被快速捕捉。

2. 辟谣成本增加,加剧舆论场混乱

AI谣言给官方的辟谣工作造成困难,主要体现在辟谣速度滞后和辟谣效果削弱两个方面。由于AI谣言生成呈现速度快、批量化的特征,尤其是关于公共安全的谣言内容,在短时间内可以实现大范围的传播,但相对来说辟谣则需要更加谨慎,无论是对AI谣言的识别还是溯源,都要花费比较长的时间成本,辟谣速度难以跑赢AI谣言的传播速度。另外,由于AI无法识别信源的真实性,因此可能会将过往的谣言内容二次输出,导致谣言再次回流舆论场,辟谣的同时还会有源源不断的新谣言出现。如“80后死亡率5.2%”的谣言被辟谣后,有网民在AI大模型中输入问题:“50后、60后、70后、80后,这几代人的死亡率分别是多少?”,AI给出的回答仍然是5.2%。由此可见谣言可能会借AI形成二次传播,进而增加辟谣难度,混乱局面难以快速终结。

3. 侵蚀公众认知 影响社会稳定

“AI幻觉”也可能会给公众带来“认知幻觉”。随着AI技术的发展,部分公众对AI技术产生一种“技术崇拜”心态,对AI输出的信息的判断能力和认知水平整体下降,特别当某个“不同文案同一结论”的信息重复多次出现,即便公众此前对网络信息的真实性有所怀疑,公众内心的确信也可能产生动摇。这种盲从或依赖心理在公共安全、重大突发等事件中体现得最突出,社会危害性更大。比如事件发生后,公众对伤亡人数、救援进展等方面的信息需求十分急切,而趁机侵入的AI谣言生成虚假现场图片,以文字形式夸大伤亡人数和破坏程度等,无疑会引发公众强烈焦虑感。当肉眼难辨的AI工具输出的信息越来越像人类创作的内容,甚至连转发、评论等互动表现也与真实用户高度一致,真实和虚假的边界逐渐模糊,就会严重扰乱社会秩序,影响社会稳定。

舆情建议

AI技术快速发展的同时为虚假信息的治理带来了新的挑战。面对网络中不断出现的AI谣言,属地公安、网信等部门迅速开展核查,在查清事实后及时辟谣,让造谣者承担相应法律责任,受到舆论认可。目前,国家已制定了一系列明确的法律法规,对AI造谣行为进行规制监管,比如《网络音视频信息服务管理规定》《互联网信息服务深度合成管理规定》《生成式人工智能服务管理办法》等,通过设置标识等方式提醒用户辨别虚假信息,明确相关服务主体的标识责任义务,规范内容操作、传播各环节标识行为,为依法治谣提供了重要法律依据。如何从社会治理层面开展AI谣言治理工作,从舆论呼声来看,以下两点建议供参考。一是建立行之有效的网络监管机制。公安、网信等部门需加强日常网络巡逻,对疑似谣言的线索快速核实,尽早阻断谣言发酵。在操作层面上,要利用AI工具进行技术对抗,加强对事件的真实性判断,提高辟谣效率和精准度。二是在通报处置上,需重视辟谣信息发布频次,同时进行阶段性的集纳式通报,强化和巩固公众对于事实的认知。对一些造成恶劣影响的谣言要保持高压态势,严肃追责造谣者和恶意传播者,营造风清气正的网络空间。

阅读全文可订阅

《政法舆情》电子产品

详情咨询:010-84772595

来源:http://www.legaldaily.com.cn/index/content/2025-05/16/content_9183906.html

责任编辑:SONGZIDONG

上一篇:

AI技术本应增进人类福祉,绝不能沦为造谣的工具

下一篇:

广西贵港:是谁在让这家投资上亿的热能企业陷入困境?

京公网安备11010802043785号

京公网安备11010802043785号